中部大学工学部 情報工学科 山内研究室は生体の脳に学んだ人工知能を構築する基礎研究をしています。

TEL. 0568-51-9391

〒487-8501 愛知県春日井市松元町1200

研究成果例:Edgeデバイス上で働く逐次学習アルゴリズムEADLINE

マイクロコンピュータ(マイコン)のようにリソースの限られた環境下でリアルタイムで追加学習が可能な微小ニューラルネットワークを構築しています。 新しいサンプルが来たら、

①直後に適応し、

②破滅的忘却を起こさず、

③汎化能力も高い

ニューラル学習エンジンです。

何分、小さなマイコン上のことです。追加学習時に必要な過去のサンプルの再学習を行う等の重い作業は困難です。

つまり与えられたサンプルを保持するスペースもなければ、再学習するCPUパワーの余裕もありません。

サンプルは一切保持することなく①②③を実現することが求められるのです。これは極めてチャレンジングなことです。

私達はこれを実現する手法を2009年から開発してきました。最初にリリースした Limited General Regression Neural Network (LGRNN)[1]では、Kernel法を使ってこれを実現します。Kernel法はニューラルネットワークが実現する関数空間上の差を学習サンプルを一切参照せずに評価できます。これを使って忘却の量を見積もることで学習戦略を切り替えて追加学習を実現します。

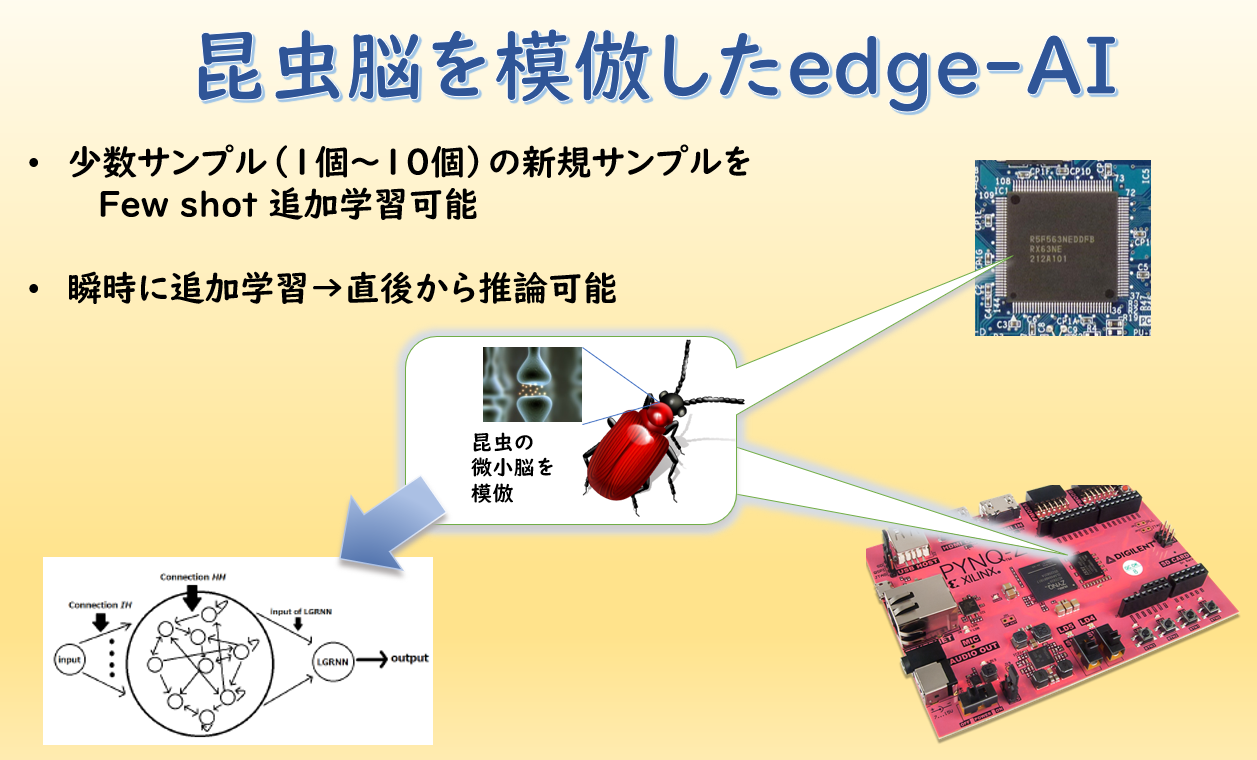

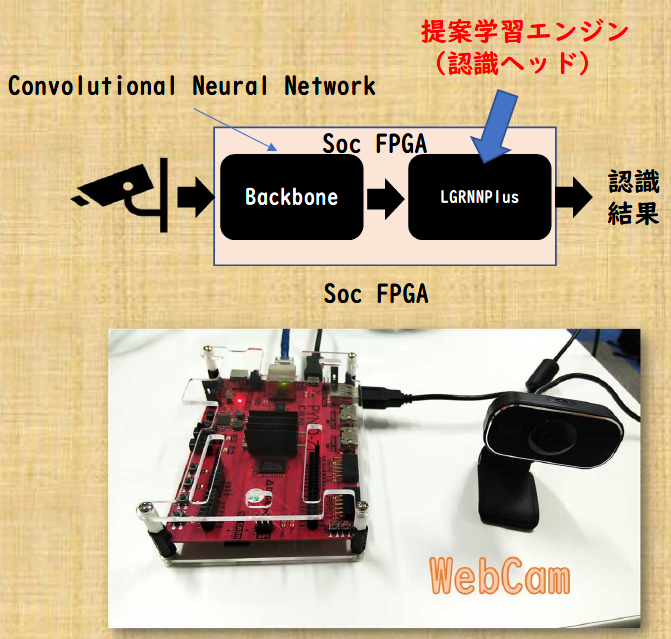

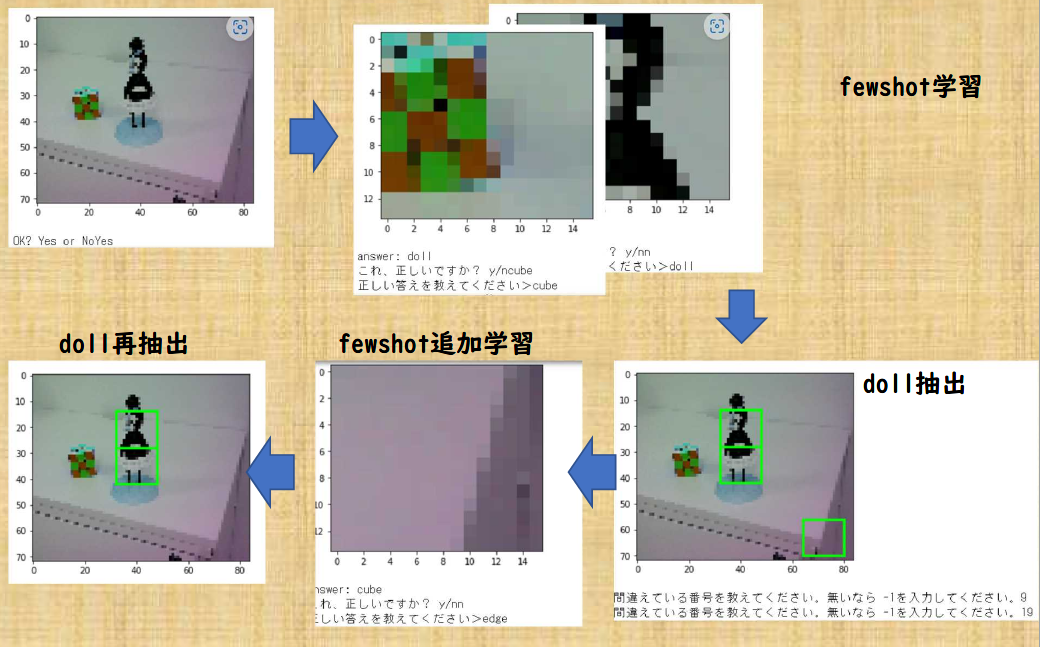

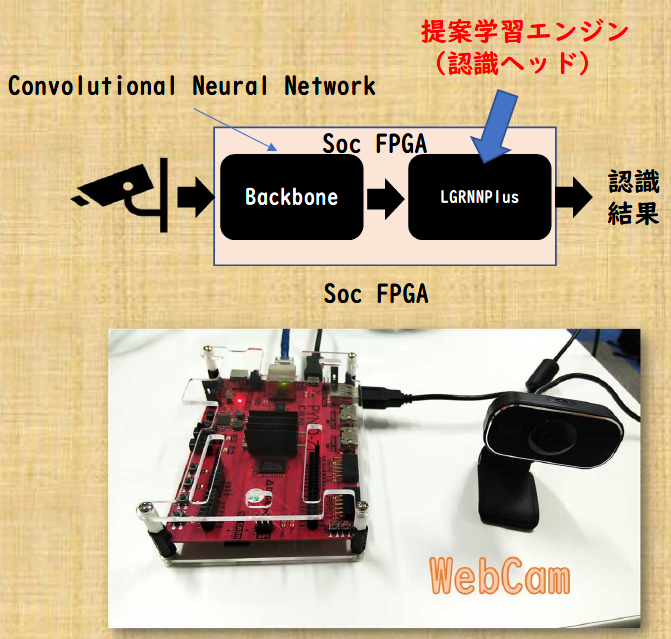

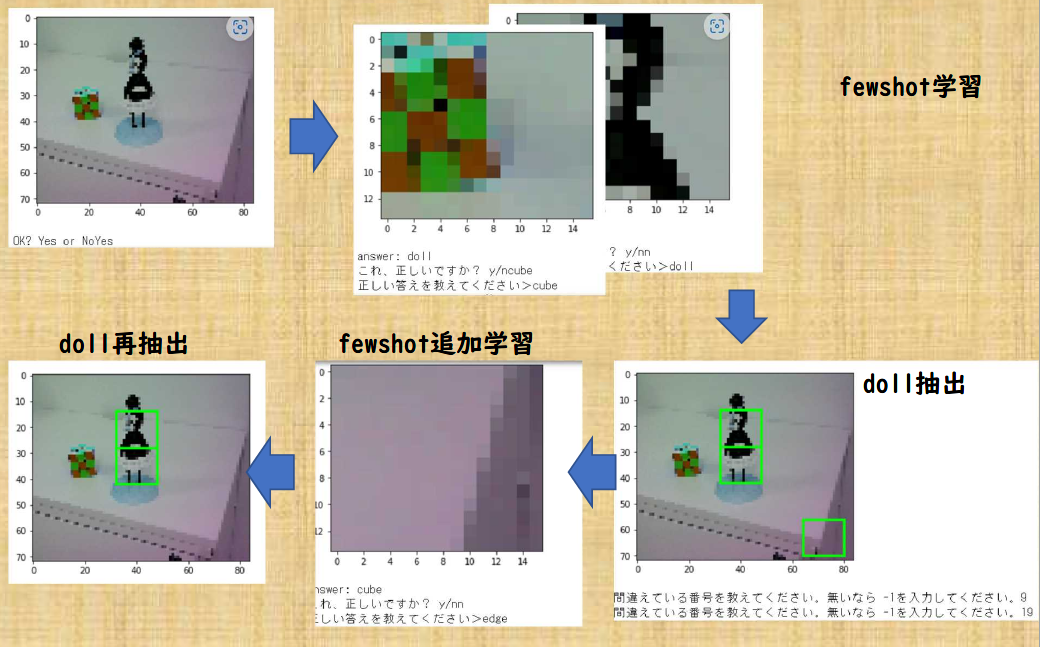

LGRNNをリリースしてから8年かかって、ようやく最新版のLGRNNPlusをリリースしました[2]。LGRNNPlusはLGRNNが運用する複数の学習戦略を、ソフトに最適配分することにより、LGRNNよりもさらに、平均20%累積誤差を抑えることに成功しました。特に学習初期段階における誤差は、他の類似学習手法を大きく凌駕しており[2]、少数サンプルでの学習に強みがあります。LGRNNPlusはDeep Neural Networkと組み合わせて、認識ヘッドとして活用することで、近年多方面で研究されている画像のfewshot追加学習も組み込み機器上で実現できます。これをFPGAボードに組み込んで画像のオンボード学習・認識を行うプロトタイプを実現しました。

プロトタイプ

fewshot 追加学習の実行例

※開発秘話

組込用学習エンジンではリソースマネージメントが必要になります。限られたリソース以内で学習するには、不要な記憶を積極的に忘却する必要が生じます。

しかし、不要な記憶と言っても、1つの記憶表現は別の記憶表現の一部ともなっています。忘却させるべく取り除くと、多少なりとも過去の記憶に影響が出るのです。

これを防ぐためにSoftMaxカーネルを使用して、1つのカーネルの記憶が他に影響することを極力避ける工夫をしています。

しかし、ベンチマークテストで他を凌駕するにはそれだけでは全く不十分でした。取り除く際の影響の量を予測し、さらに影響を減少させるべくパラメータを精緻に調整しないととてもじゃないけど勝てない!

このパラメータ調整には忘却の量を過去のサンプルを参照せずに評価する必要があります。そのためにはKernelトリックなる数学的テクニックが必須になります。しかし、LGRNNが使用するカーネルは、再生カーネルの条件を満たしません。つまりkernelトリックは使えないことになります。この事実に気が付くのに恥ずかしながら時間がかかり、回り道をしながら9年間も試行錯誤が続いたのでした。

最終的に落ち着いたのは「線形近似」です。文献[1]:LGRNNはいわばヒューリスティクスでこれを実現したものですが、文献[2]:LGRNNPlusでは、この近似による学習理論が展開されています。LGRNNPlusはLGRNNよりも平均20%程累積誤差を抑える能力があります。(UCI-machine learning repositoryのregression用ベンチマークデータセットで検証)

昆虫脳のモデル:

昆虫の脳は非常に小さいにもかかわらず、知的な行動を生み出します。このメカニズムに興味があります。LGRNN,LGRNNPlusは、純粋な工学的モデルとして構築されたリソース制限下の追加学習モデルですが、昆虫脳のモデルとなり得るかもしれません。

つまりLGRNNが「昆虫脳を模倣した」学習エンジンと呼ぶのは実は適切ではないのですが、最近明らかになりつつある昆虫の脳の学習様式:不要な記憶を積極的に忘却する方式を大筋で踏襲していること自体は事実であり、現在進行中の研究プロジェクトにて昆虫脳のモデルとして見た場合の妥当性についても調査中です[3]。

これまでは思いも寄らなかったような昆虫の学習戦略を発見して、工学モデルに取り入れ、さらなる性能向上ができた、、という結果に至ることを期待して研究をしています。

関連論文&プロジェクト

[1]Koichiro Yamuchi. "Incremental learning on a budget and its application to quick maximum power point tracking of photovoltaic systems", Journal of Advanced Computational Intelligence and Intelligent Informatics, vol.18, No.4, pp. 682--696 (2014).(LGRNN)

[2]K.Yamauchi: "Quick continual kernel learning on bounded memory space based on balancing between adaptation and forgetting" Evolving Systems (2022) (LGRNNPlus)

https://doi.org/10.1007/s12530-022-09476-8

[3] 日本学術振興会科学研究費助成金 基盤C 課題番号22K12176 カーネル法による昆虫脳の学習戦略のモデル化と組み込み用追加学習エンジンの開発 (2022年度~)

研究成果の例:

①直後に適応し、

②破滅的忘却を起こさず、

③汎化能力も高い

ニューラル学習エンジンです。

何分、小さなマイコン上のことです。追加学習時に必要な過去のサンプルの再学習を行う等の重い作業は困難です。

つまり与えられたサンプルを保持するスペースもなければ、再学習するCPUパワーの余裕もありません。

サンプルは一切保持することなく①②③を実現することが求められるのです。これは極めてチャレンジングなことです。

私達はこれを実現する手法を2009年から開発してきました。最初にリリースした Limited General Regression Neural Network (LGRNN)[1]では、Kernel法を使ってこれを実現します。Kernel法はニューラルネットワークが実現する関数空間上の差を学習サンプルを一切参照せずに評価できます。これを使って忘却の量を見積もることで学習戦略を切り替えて追加学習を実現します。

LGRNNをリリースしてから8年かかって、ようやく最新版のLGRNNPlusをリリースしました[2]。LGRNNPlusはLGRNNが運用する複数の学習戦略を、ソフトに最適配分することにより、LGRNNよりもさらに、平均20%累積誤差を抑えることに成功しました。特に学習初期段階における誤差は、他の類似学習手法を大きく凌駕しており[2]、少数サンプルでの学習に強みがあります。LGRNNPlusはDeep Neural Networkと組み合わせて、認識ヘッドとして活用することで、近年多方面で研究されている画像のfewshot追加学習も組み込み機器上で実現できます。これをFPGAボードに組み込んで画像のオンボード学習・認識を行うプロトタイプを実現しました。

プロトタイプ

fewshot 追加学習の実行例

※開発秘話

組込用学習エンジンではリソースマネージメントが必要になります。限られたリソース以内で学習するには、不要な記憶を積極的に忘却する必要が生じます。

しかし、不要な記憶と言っても、1つの記憶表現は別の記憶表現の一部ともなっています。忘却させるべく取り除くと、多少なりとも過去の記憶に影響が出るのです。

これを防ぐためにSoftMaxカーネルを使用して、1つのカーネルの記憶が他に影響することを極力避ける工夫をしています。

しかし、ベンチマークテストで他を凌駕するにはそれだけでは全く不十分でした。取り除く際の影響の量を予測し、さらに影響を減少させるべくパラメータを精緻に調整しないととてもじゃないけど勝てない!

このパラメータ調整には忘却の量を過去のサンプルを参照せずに評価する必要があります。そのためにはKernelトリックなる数学的テクニックが必須になります。しかし、LGRNNが使用するカーネルは、再生カーネルの条件を満たしません。つまりkernelトリックは使えないことになります。この事実に気が付くのに恥ずかしながら時間がかかり、回り道をしながら9年間も試行錯誤が続いたのでした。

最終的に落ち着いたのは「線形近似」です。文献[1]:LGRNNはいわばヒューリスティクスでこれを実現したものですが、文献[2]:LGRNNPlusでは、この近似による学習理論が展開されています。LGRNNPlusはLGRNNよりも平均20%程累積誤差を抑える能力があります。(UCI-machine learning repositoryのregression用ベンチマークデータセットで検証)

昆虫脳のモデル:

昆虫の脳は非常に小さいにもかかわらず、知的な行動を生み出します。このメカニズムに興味があります。LGRNN,LGRNNPlusは、純粋な工学的モデルとして構築されたリソース制限下の追加学習モデルですが、昆虫脳のモデルとなり得るかもしれません。

つまりLGRNNが「昆虫脳を模倣した」学習エンジンと呼ぶのは実は適切ではないのですが、最近明らかになりつつある昆虫の脳の学習様式:不要な記憶を積極的に忘却する方式を大筋で踏襲していること自体は事実であり、現在進行中の研究プロジェクトにて昆虫脳のモデルとして見た場合の妥当性についても調査中です[3]。

これまでは思いも寄らなかったような昆虫の学習戦略を発見して、工学モデルに取り入れ、さらなる性能向上ができた、、という結果に至ることを期待して研究をしています。

[1]Koichiro Yamuchi. "Incremental learning on a budget and its application to quick maximum power point tracking of photovoltaic systems", Journal of Advanced Computational Intelligence and Intelligent Informatics, vol.18, No.4, pp. 682--696 (2014).(LGRNN)

[2]K.Yamauchi: "Quick continual kernel learning on bounded memory space based on balancing between adaptation and forgetting" Evolving Systems (2022) (LGRNNPlus)

https://doi.org/10.1007/s12530-022-09476-8

[3] 日本学術振興会科学研究費助成金 基盤C 課題番号22K12176 カーネル法による昆虫脳の学習戦略のモデル化と組み込み用追加学習エンジンの開発 (2022年度~)

研究成果の例:

- 忘れそうな記憶を選択的に再学習する追加学習アルゴリズム(詳細説明)

- 「睡眠」を伴う追加学習アルゴリズム(詳細説明)

- 「興味」を持って学習する機械学習アルゴリズム!:逐次的モデル選択(詳細説明)

- もっと小さく低消費電力で追加学習:Edgeデバイス上で働く逐次学習理論(詳細説明)

バナースペース

中部大学工学部 情報工学科 山内研究室

〒487-8501

愛知県春日井市松元町1200

TEL 0568-51-9391

k_yamauchi[at].sti.chubu.ac.jp